* זהו מאמר המשך. כאן אפשר לקרוא את חלקו הראשון של הטקסט.

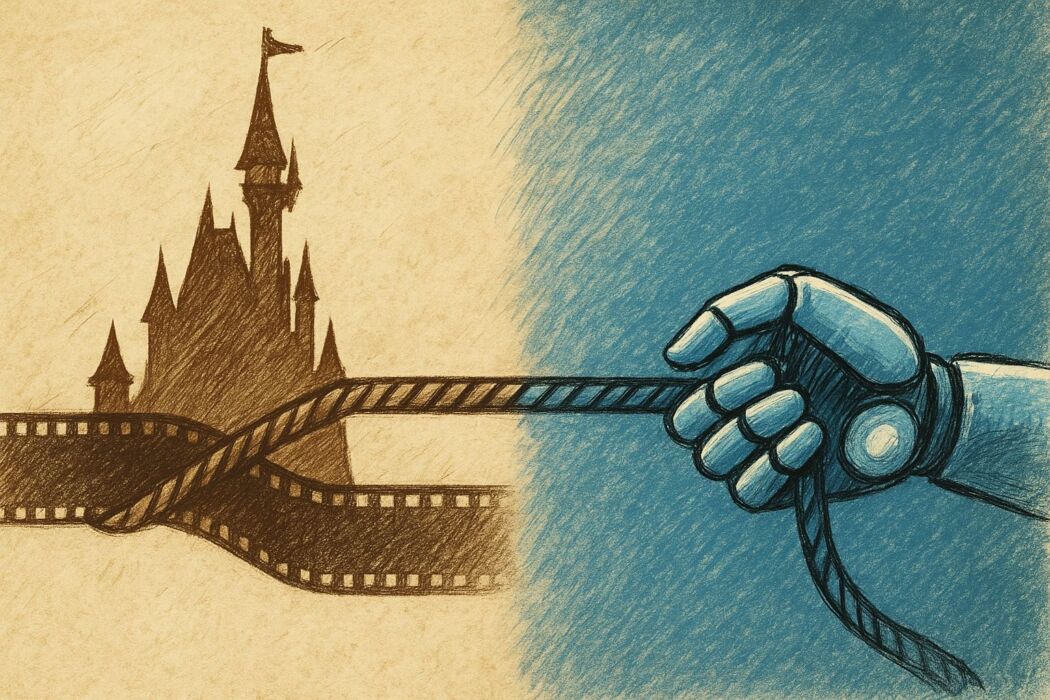

מאז שמסנתזי התמונות פרצו לחיינו לפני כשנתיים, השאלה שהכי הטרידה אותי היא מה למדה המכונה? בנק התמונות שעליו אומנה הבינה המלאכותית הוא הגורם שישפיע על התמונות החדשות שהאלגוריתם יצור. איסוף של כל בנק תמונות כזה מבוסס תמיד על אג’נדה. גלויה במקרה הטוב, מוסווית במקרה הרע. נסו לדמיין את ההבדל בין בנק הדימויים שיכלול את כל התמונות שאי פעם פורסמו ברשת בלי שום סינון; בנק הדימויים שיבחר במיוחד על ידי ענקית טכנולוגית שמנסה לשמור את כוחה תוך כדי שתנסה להוכיח שהיא אתית; או כזה שיבחר למשל על ידי ממשלת סין. כל אחד מהם יצור מן הסתם תמונות שונות מאוד.

הבעיה היא שכמעט תמיד בנק התמונות לא נגיש למשתמשים. המידע שיש לנו על פי רוב מבוסס על מה שהחברות עצמן מוכנות לספר. למשל OpenAI מספרים ש-Dall-e 2, האלגוריתם המוכר ביותר, אומן על “מאות מיליוני תמונות”. החברה ידועה בכך שלא הסכימה לפתוח את האלגוריתם שלה לשימוש, בין היתר בשל חשש רציני שאלגוריתם כזה יכול לשמש למטרות זדוניות. על כן בחברה מדווחים לעומק כיצד ערכו סינון קפדני של תוכן. בין היתר הוסר ממאגר הלמידה תוכן מיני, אלימות גרפית וכמה סמלים שנכללו במאגר של Hate on Display™ Hate Symbols Database. כמו כן אין במאגר תמונות של אנשים אמיתיים או דמויות בדיוניות עם זכויות יוצרים. מעניין לקרוא בהסברים את הפסקה שמתארת כיצד עובדי החברה גילו כי “בהסרת כל התכנים המיניים הייתה פגיעה באופן בו האלגוריתם מייצג נשים באופן כללי” 1. במקום אחר מסופר כי הסינון גרם לאלגוריתם לייצר יותר תמונות של גברים 2. על כן ערכה החברה התאמות לאופן סינון התכנים. מהן אותן ההתאמות? אנו לא יודעים.

בנוסף, OpenAI מספרים כי האלגוריתם יכול להפר זכויות יוצרים אם תמונה מופיעה בגרסאות דומות רבות במאגר – בכך שהוא פשוט משחזר אותה. על כן הם ערכו סינון קפדני של תמונות שחוזרות על עצמן. לסכנות ש-OpenAI מוכנים לחשוף צריך להוסיף עוד כמה. למשל העובדה שבנקי התמונות שנאספו כביכול ממאגרים ללא זכויות יוצרים, כוללים פעמים רבות גם דימויים שלא באמת אמורים להיות שם. לדוגמה כאלו שהועלו למאגרים ללא הסכמה או ידיעה של היוצרים. אין דרך לדעת אילו תמונות נכללו במאגר, ולכן יש שאלה רצינית כיצד ניתן לפתור בעיות מסוג זה.

עוד אלגוריתם מעניין ומרכזי הוא Midjourney, שמאפשר ליוצרים מעט יותר שליטה מדאל-אי 2, למרות שגם הוא משתמש במאגרים סגורים. ב-Midjourney חושפים אפילו פחות מ-OpenAI ועל כן לא באמת ברור אם החברה מסננת תכנים באותה הצורה. אפשר למצוא בהוראות השימוש דרישה שלא ליצור תכנים פוגעניים, אחרת המשתמש עלול להיחסם, אך לא ברור מהם אמצעי האכיפה של החברה, או האם היא מבצעת סינון תכנים מראש כמו OpenAI.

נראה לי (ולעוד כמה בלוגרים) שהאלגוריתם של Midjourney מבוסס הרבה יותר על אמנות, ובמיוחד אמנות פופולרית, אבל אין שום דרך להוכיח את זה. בכל אופן, האלגוריתם הראשי של החברה (יש אפשרות לבחור בין כמה שונים), נוטה ליצור ציורים שמזכירים מאוד את הדימויים בפורומים ישנים כמו deviantart, ויש לו הרבה יותר אופי מובחן מאלגוריתמים אחרים. כיצד נוצר מצב זה? אולי נדע ביום בו יתגלה מידע נוסף.

כך או אחרת, כפי שהציג יפה הבלוגר ההודי לוקש צ’ודהרי 3 גם לאחר כל הסינונים הברורים מאליהם, אלגוריתמים מסוג זה נוטים להיות סטריאוטיפיים מאוד. למשל, כאשר מבקשים ממסנתז תמונות ליצור תמונה של רופא מול בית חולים הוא כמעט תמיד יציג גבר, ואחות מול בית חולים כמעט תמיד תהיה אישה (באנגלית אין שיוך מגדרי לשם המקצוע); מי שמבשל במטבח ביתי הן לרוב נשים; הנשיא הוא לרוב אמריקני; בעלי מקצוע הודיים יהיו פעמים רבות בלבוש מסורתי ולא מודרני; בתים בהודו יהיו קטנים ומרופטים ועוד.

גזענות מסווית: “אחות מול בית חולים”, “רופא מול בית חולים”. הדימויים נוצרו ב- Midjourney ולקוחים מהמאמר של לוקש צ’ודהרי [3]

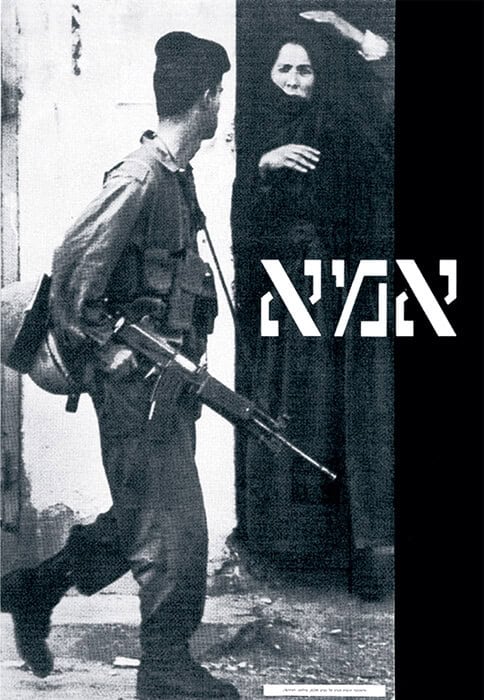

בנק התמונות היחיד שפתוח לציבור ואפשר לראות מה יש בתוכו שייך למסתנז התמונות Stable Diffusion. בנק התמונות הזה נאסף על ידי קבוצה בשם LAION שמומנה ברובה על ידי החברה שהוציאה את Stable Diffusion, Stability AI. הבנק, שכולל 2.3 מיליארד תמונות, כביכול זמין, אבל לסקור היקף כזה זו משימה כמעט בלתי אפשרית. ובכל זאת, הבלוגר אנדי בריו והמתכנת סימון וויליסון צללו לתוך בנק התמונות וסקרו כ-12 מיליון דימויים שנלקחו מהאסופה בעלת האיכות הכי גבוהה במאגר 4. אגב, את המאגר הם העלו לרשת כך שגם אתן.ם יכולות.ים להציץ בו 5. התמונות במאגר מהוות אוסף מייצג באופן יחסי, למרות שהאיכות שלהן גוררת גם העדפות אסתטיות מסוימות (תמונות באיכות גבוהה הן לרוב “יפות” יותר למשל).

המסקנה הראשונה שהשיטוט של בריו ווילסון באוסף הניב, היא שכמעט מחצית מן התמונות (47%) הגיעו ממאה דומיינים בלבד. המקור העיקרי היה פינטרסט (8.5%); אחר כך תמונות מבלוגים של וורד-פרס (6.8%); חברת Fine Art America שמוכרת פוסטרים היוותה גם היא מרכיב משמעותי (5.8%), לצד עוד כמה חברות שמתעסקות במכירת מוצרים.

כמו כן נערכה ספירה של אזכורי אמנים במאגר. צייר הקיטש האמריקני טומאס קינקייד נוכח במאגר מעט יותר מואן גוך, שהגיע למקום השני, וצייר הקיטש הישראלי-ליטאי לאוניד אפרמוב עקף את קלוד מונה, שהגיע למקום רביעי. יחד עם זאת, יש גם בעיות שנוצרות מתיוג. אם מחפשים אמני קומיקס, מגלים שהראשון ביניהם הוא סטן לי, שהיה כותב קומיקס ובעיקר יו”ר מארוול, אבל מתויג הרבה יותר מאמני הקומיקס עצמם.

ב-Stable Diffusion יש פחות סינון מדאל-אי, ועל כן אפשר למצוא במאגר תמונות של אנשים מוכרים, ביניהן מוביל דונאלד טראמפ. בקטגוריית הדמויות הבדיוניות מעניין לראות שקפטן מארוול מובילה (אני לא לגמרי מבין למה. אולי כי זה התפרסם ממש לאחרונה והיא הייתה חלק ממלחמות מגדר למיניהן בבלוגים וכו’).

לבסוף, במאגר של Stable Diffusion יש גם תמונות עירום ואלימות. המאגר עצמו מסווג הבחנות בין תוכן ״הולם״ ו״בלתי הולם״ באמצעות מספרים מאחד עד עשר, ובאחד הראיונות הכריז חבר צוות ב-LAION שכ-2.9% מהתמונות במאגר הן בלתי הולמות. בכל זאת, הבלוגרים שסקרו את התמונות מצאו רק אחוז מזערי מאוד של תמונות שקיבלו את הציון המסוכן ביותר (0.002%), ואלו היו תכנים פורנוגרפיים. כמו כן כמעט שלא נמצא עירום באחוז משמעותי ביתר המאגר, מה שהעלה את הסברה שהסינון המדובר שייך ל-Stable Diffusion ולא כלל הרבה תכנים שאנשי LAION חשבו שהם בלתי הולמים, או שההגדרה של אלו לתוכן שאינו הולם שונה מזו של המסננים. אפשר להוסיף לסברות הללו את האפשרות שתכנים מסוג זה אולי פחות נפוצים באיכות כה גבוהה.

כך או אחרת, יש להבין שבעיית ההתבססות על בנק ידע קיים כזה או אחר היא אינהרנטית לטכנולוגיה. המשמעות היא שלתמונות שייצור המסנתז תמיד תהיה אג’נדה – גם ובעיקר אם בנק התמונות יבחר בקפידה בהתבסס על אמונה כזו או אחרת בנוגע לאתיקה.

לעומת השאלה שהעלה וולטר בנימין בנוגע לכלי השעתוק הטכני – האם הכלים יהיו זמינים לציבור – לדעתי יש להעלות שאלה אחרת וחשובה לא פחות: האם האלגוריתמים עצמם עומדים להיות פתוחים לציבור? עד כמה נוכל לצלול לעומקם ולגלות על מה הם מתבססים? כך או אחרת, כל עוד מכסה המנוע של רובם ישאר סגור, נאלץ להיכנס לקופסאות השחורות שהן שורת הטקסט שאנו מזינים ולנסות בעצמנו לקבל תוצאות.

חברי קבוצת הרכישה של מוזיאון תל אביב לאמנות “בוחרים אמנות”, רכשו 35 עבודות של 11 אמניות ואמנים ישראלים עכשוויים עבור אוספי האמנות של מוזיאון תל אביב לאמנות. כמידי שנה, משקפת בחירת העבודות מכלול דגשים הנוגעים לייצוג רב דורי, גיוון מדיומלי, תמיכה בהתפתחותם של אמניות ואמנים בכירים במהלך דרכם האמנותית וכניסה ראשונה של אמנים, שלא זכו עד כה בייצוג יצירתם, לאוסף.

חברי קבוצת הרכישה של מוזיאון תל אביב לאמנות “בוחרים אמנות”, רכשו 35 עבודות של 11 אמניות ואמנים ישראלים עכשוויים עבור אוספי האמנות של מוזיאון תל אביב לאמנות. כמידי שנה, משקפת בחירת העבודות מכלול דגשים הנוגעים לייצוג רב דורי, גיוון מדיומלי, תמיכה בהתפתחותם של אמניות ואמנים בכירים במהלך דרכם האמנותית וכניסה ראשונה של אמנים, שלא זכו עד כה בייצוג יצירתם, לאוסף.

[…] לחלקו השני של המאמר […]

אמנות בעידן השעתוק האלגוריתמי, חלק ראשון: מדא-פ'ן לדאל-אי – ערב רב Erev Rav

| |מעניין מתי נוכל אמנים או יוצרים יוכלו לייצר לעצמם מאגר תמונות ממנו המכונה תלמד את הסגנון שלהם ותוכל לייצר להם אמנות בהתאם.

גיא מ.

| |בסטייבל דיפיוז׳ן, מי שמבין, יכול לעשות את זה כבר היום

אלעד ירון

| |לא כל דבר הוא גזענות.

אם בעולם המציאותי רוב הרופאים הם זכרים ורוב האחים נקבות, וכפי הנראה הדבר משתקף גם בעולם האמנות האנושי, אזי אין שום סיבה לצפות שדוקא הבינה המלאכותית “תתגבר” על הריאליזם לטובת ערכים סובייקטיביים וערטילאיים של שוויון ותקינות פוליטית.

להיפך. הוספה של פילטרים “ערכיים”/”מוסריים” למערכות בינה מלאכותית היא הרבה יותר מטרידה ומדאיגה מאשר מועילה. זה עשוי להתחיל בציורים של רופאות ואחים אבל המדרון חלקלק ובהמשך יבואו נסיונות לעוות או ליפות את המציאות, להעלים דעות ועובדות “אסורות”, להשתלט על השיח ולהטמיע בו ערכים שנויים במחלוקת ואף פסבדו עובדות שקריות לחלוטין.

בינה שתשקף את המציאות הקיימת ללא פילטרים “ערכיים” הרבה פחות מטרידה. היא תמשיך לשקף את העולם כמות שהוא על חסרונותיו ומגבלותיו. רק לאחר שהמציאות עצמה תשתנה, בהדרגה תשתנה גם האמנות האנושית, ולבסוף תשתנה גם האמנות המלאכותית.

חיים ארוכים

| |מצד אחד אני לאו דווקא מצדד בפילטרים. מצד שני בארהב כיום, למשל, כמות הרופאות גדולה מכמות הרופאים. זו לכן אמירה שמסתמכת בדיוק על הדימוי הלא נכון שנצרב לנו בראש ודי מוכיחה את כוחו של דימוי.

אלעד ירון

| |